- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:52.

- Modificat ultima dată 2025-01-22 17:37.

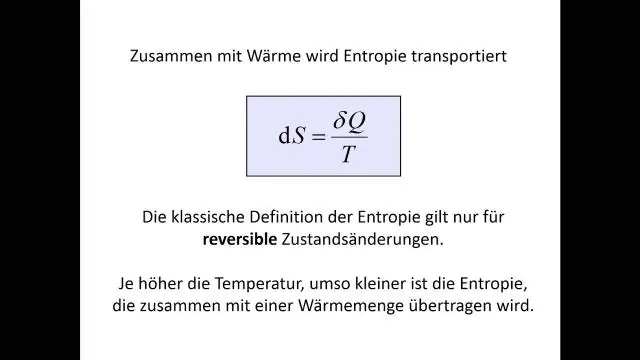

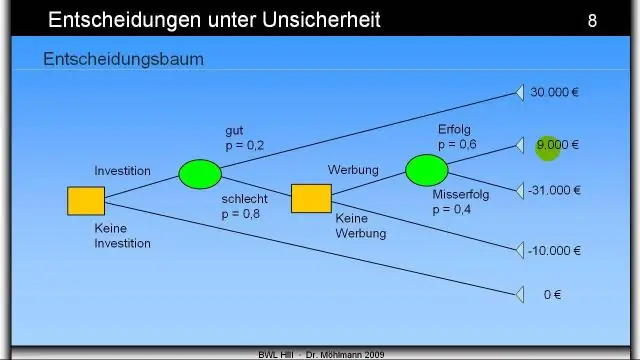

Entropie : A arborele de decizie este construit de sus în jos dintr-un nod rădăcină și implică partiționarea datelor în subseturi care conțin instanțe cu valori similare (omogene). Utilizează algoritmul ID3 entropie pentru a calcula omogenitatea unei probe.

Oamenii se întreabă, de asemenea, care este definiția entropiei în învățarea automată?

Entropie , așa cum se referă la învățare automată , este o măsură a aleatoriei informațiilor care sunt procesate. Cu cât este mai mare entropie , cu atât este mai greu să tragi concluzii din acele informații. Aruncarea unei monede este un exemplu de acțiune care oferă informații aleatorii. Aceasta este esența entropie.

Alături de mai sus, ce este câștigul de informații și entropia în arborele de decizie? The câștig de informații se bazează pe scăderea în entropie după ce un set de date este împărțit pe un atribut. Construirea unui arborele de decizie este totul despre găsirea atributului care returnează cel mai mare câștig de informații (adică cele mai omogene ramuri). Rezultatul este Câștig de informații , sau scăderea în entropie.

De asemenea, știți, care este valoarea minimă a entropiei într-un arbore de decizie?

Entropie este cel mai jos la extreme, când bula fie nu conține instanțe pozitive, fie doar instanțe pozitive. Adică, când bula este pură, tulburarea este 0. Entropie este cel mai mare la mijloc atunci când bula este împărțită uniform între cazuri pozitive și negative.

Ce este entropia în pădurea aleatoare?

Ce este Entropia și de ce informații câștigă importanță în Decizie Copaci? Nasir Islam Sujan. 29 iunie 2018 · 5 minute de citit. Conform Wikipedia, Entropie se referă la dezordine sau incertitudine. Definiție: Entropie sunt măsurile de impuritate, dezordine sau incertitudine într-o grămadă de exemple.

Recomandat:

Care este definiția observațiilor calitative și cantitative?

Implica observarea a tot ceea ce poate fi măsurat, cum ar fi diferențele de forme, dimensiuni, culoare, volum și numere. Observația calitativă este un proces subiectiv de culegere de date sau informații, în timp ce observația cantitativă este un proces obiectiv de culegere de date sau informații

Cum funcționează arborele de decizie în R?

Arborele de decizie este un tip de algoritm de învățare supravegheată care poate fi utilizat atât în probleme de regresie, cât și în probleme de clasificare. Funcționează atât pentru variabilele de intrare și de ieșire categorice, cât și continue. Când un sub-nod se împarte în alte sub-noduri, se numește Nod de decizie

Care este cea mai bună explicație a variabilelor de decizie?

O variabilă de decizie este o cantitate pe care decidentul o controlează. De exemplu, într-un model de optimizare pentru programarea travaliului, numărul de asistente care trebuie angajate în timpul turei de dimineață într-o cameră de urgență poate fi o variabilă de decizie. Motorul OptQuest manipulează variabilele de decizie în căutarea valorilor optime ale acestora

Care este adâncimea unui arbore de decizie?

Adâncimea unui arbore de decizie este lungimea celei mai lungi căi de la o rădăcină la o frunză. Mărimea unui arbore de decizie este numărul de noduri din arbore. Rețineți că, dacă fiecare nod al arborelui de decizie ia o decizie binară, dimensiunea poate fi la fel de mare ca 2d+1−1, unde d este adâncimea

Arborele de decizie este o regresie?

Arborele de decizie - regresie. Arborele de decizie construiește modele de regresie sau clasificare sub forma unei structuri arborescente. Cel mai de sus nod de decizie dintr-un arbore care corespunde celui mai bun predictor numit nod rădăcină. Arborii de decizie pot gestiona atât date categorice, cât și date numerice