- Autor Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:52.

- Modificat ultima dată 2025-01-22 17:37.

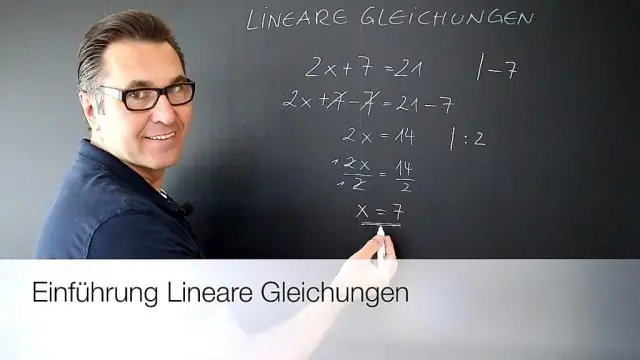

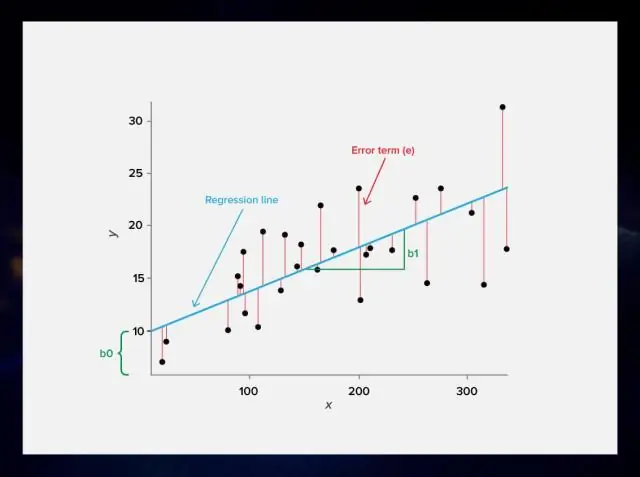

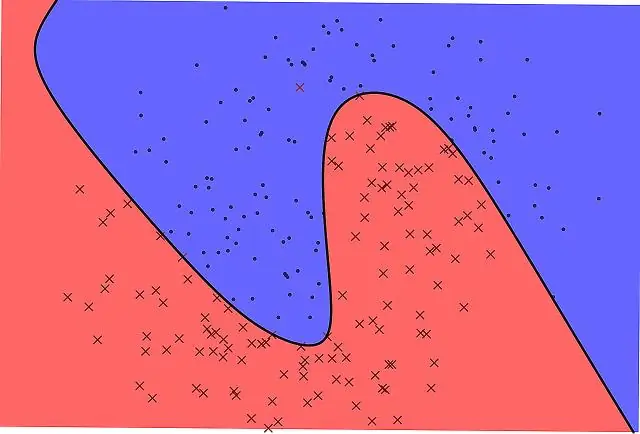

Regularizare . Aceasta este o formă de regresie , care constrânge/regularizează sau micșorează estimările coeficienților spre zero. Cu alte cuvinte, această tehnică descurajează o învățare mai complexă sau mai flexibilă model , astfel încât să se evite riscul supraajustării. O relatie simpla pentru regresie liniara arata asa.

În mod corespunzător, ce este lambda în regresia liniară?

Când avem un grad înalt liniar polinom care este folosit pentru a potrivi o mulțime de puncte în a regresie liniara setare, pentru a preveni supraadaptarea, folosim regularizarea și includem a lambda parametru în funcția de cost. Acest lambda este apoi folosit pentru a actualiza parametrii theta din algoritmul de coborâre a gradientului.

În al doilea rând, care este scopul regularizării? Regularizare este o tehnică folosită pentru reglarea funcţie prin adăugarea unui termen suplimentar de penalizare în eroare funcţie . Termenul suplimentar controlează fluctuația excesivă funcţie astfel încât coeficienții să nu ia valori extreme.

În acest fel, de ce trebuie să ne regularizăm în regresie?

Scopul de regularizare este de a evita supraadaptarea, cu alte cuvinte noi încearcă să evite modelele care se potrivesc extrem de bine la datele de antrenament (date folosite pentru a construi modelul), dar care se potrivesc slab la datele de testare (date folosite pentru a testa cât de bun este modelul). Acest lucru este cunoscut sub numele de supraajustare.

Ce înseamnă regularizare?

În matematică, statistică și informatică, în special în învățarea automată și probleme inverse, regularizarea este procesul de adăugare a informațiilor pentru a rezolva o problemă prost pusă sau pentru a preveni supraadaptarea. Regularizare se aplică funcțiilor obiective în probleme de optimizare prost puse.

Recomandat:

Căutarea liniară este aceeași cu căutarea secvențială?

Clasa: algoritm de căutare

Care este numele primei mașini de editare liniară?

Metoda liniară de editare presupune aranjarea în ordine a imaginilor și a sunetelor. La început, aceasta a implicat folosirea foarfecelor pentru a îmbina materialul și apoi a folosi bandă pentru a le atașa în ordinea corectă. Astfel de metode au fost folosite până în anii 1920, când a fost inventată prima mașină de editare, numită Moviola

Ce este regresia ML?

Regresia este un algoritm ML care poate fi antrenat pentru a prezice rezultate reale numerotate; precum temperatura, prețul acțiunilor etc. Regresia se bazează pe o ipoteză care poate fi liniară, pătratică, polinomială, neliniară etc. Ipoteza este o funcție care se bazează pe niște parametri ascunși și pe valorile de intrare

Cum funcționează regresia bayesiană?

Din punctul de vedere bayesian, formulăm regresia liniară folosind distribuții de probabilitate mai degrabă decât estimări punctuale. Modelul pentru regresia liniară bayesiană cu răspunsul eșantionat dintr-o distribuție normală este: Ieșirea, y este generată dintr-o distribuție normală (gaussiană) caracterizată printr-o medie și varianță

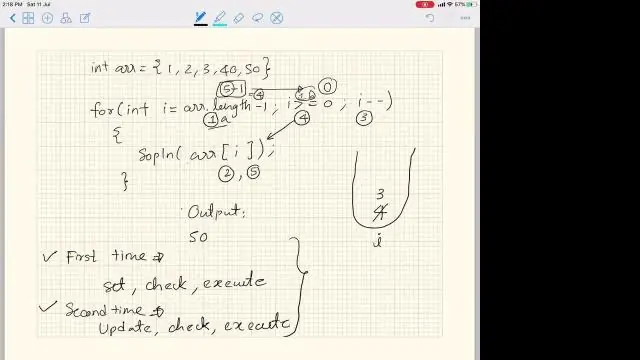

Ce este structura de date liniară în structura de date?

Structură de date liniară: structură de date în care elementele de date sunt aranjate secvențial sau liniar, unde elementele sunt atașate la adiacentul anterior și următor în ceea ce se numește o structură de date liniară. În structura de date liniară, este implicat un singur nivel. Prin urmare, putem parcurge toate elementele doar într-o singură rulare